23.06.2011, 00:00 Uhr

Neue Programmiermodelle für Hochleistungsrechner gesucht

Die Universität des Saarlandes will Hochleistungsrechner mit Hilfe von neuen Programmiermodellen noch viel schneller machen. Gefördert wird das Projekt ECOUSS vom Bundesministerium für Bildung und Forschung.

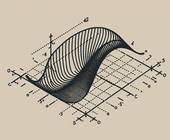

Wenn Autobauer einen Crashtest am Computer simulieren oder Klimaforscher die weltweiten Wetterdaten auswerten, benötigen sie vor allem eines: viel Rechenpower. Dafür werden heute Tausende von Prozessoren auf einer Plattform zusammengeschaltet. Doch wenn viele Computer parallel an einer Aufgabe rechnen, werden sie nicht automatisch schneller, denn häufig ist ihre Software dafür gar nicht ausgelegt. Das Bundesministerium für Bildung und Forschung fördert jetzt mit 1,69 Millionen Euro das Projekt „Effiziente und offene Compiler Umgebung für semantisch annotierte parallele Simulation“ (ECOUSS) , das zum Ziel hat, die neuen parallelen Rechnerarchitekturen viel effizienter als bisher zu nutzen. Daran sind auch Institute der Saarbrücker Informatikforschung maßgeblich beteiligt.

Noch vor wenigen Jahren konnte man davon ausgehen, dass Computerprogramme mit jeder neuen Rechnergenerationen schneller wurden. Mit den immer kleineren Prozessoren stieß man jedoch an physikalische Grenzen, so dass die Chipindustrie dazu überging, die Rechner mit mehreren Prozessorkernen auszustatten. Für besonders rechenintensive Aufgaben werden zudem tausende Computer in Hochleistungsnetzwerken zusammengeschlossen. „Das Problem dabei ist, dass die Programmiersprachen und Werkzeuge, mit denen wir die neuen Rechnerarchitekturen programmieren, auf rund vierzig Jahre alten Rechenmodellen beruhen. Damals haben die Computer aber noch nicht mehrere Millionen Aufgaben parallel berechnen können“, erklärt Sebastian Hack, Professor für Programmierung der Universität des Saarlandes und Forscher am Intel Visual Computing Institute der Saar-Uni.

Nach Meinung von Sebastian Hack nutzen die Computerprogramme heute die Möglichkeit der Hardware, viele Probleme gleichzeitig zu bearbeiten, noch viel zu wenig aus. Oftmals entstünden auch Engpässe und Flaschenhälse im System, weil Daten nicht schnell genug aus den zahlreichen Arbeitsspeichern geladen werden oder schon gelöste Aufgaben auf die Weiterbearbeitung warten. „Man stelle sich vor, ein Kochrezept wird nicht nur von einem Koch befolgt, sondern soll gleichzeitig von zehn Köchen in einer Küche umgesetzt werden. Da muss auch erst geklärt werden, wer welchen Kochtopf benutzen darf und ob die Vorräte für alle ausreichen“, vergleicht der Informatiker. Bei zehn Arbeitsschritten eines Kochrezeptes ginge das noch einfach, nicht aber bei Hundert Millionen Rechenaufgaben, die etwa für die Vorhersage eines Hurrikans in Sekundenschnelle gelöst werden müssten.

Die Computersimulation von physikalischen Modellen, die etwa auch der Medizin und Pharmazie wichtige Erkenntnisse bringen, benötigt daher noch viel Handarbeit. So muss die Simulationssoftware immer wieder individuell an die Anforderungen der Hochleistungsrechner angepasst werden. „Hier setzt unser Forschungsprojekt an: Wir wollen durch neue Methoden und Werkzeuge diese Anpassung vereinfachen und zum Teil automatisieren. Da die zu lösenden Aufgaben meist sehr komplex sind, werden wir den Programmierer nicht ersetzen können, wir werden aber seine Arbeit erleichtern und beschleunigen können“, meint Sebastian Hack. Im Visier haben die Forscher dabei vor allem die Compiler, die vom Menschen geschriebene Programme in eine dem Rechner verständliche Sprache übersetzen. „Es ist nahezu unmöglich, die verfügbare Rechenleistung automatisch auszunutzen. Das erfordert normalerweise einen mühsamen und kostspieligen manuellen Prozess, dessen Ergebnisse man mit einer neuen Rechnergeneration wieder wegwerfen muss. Genau diesen Prozess wollen wir effizienter gestalten, in dem wir dem Programmierer die richtigen Werkzeuge an die Hand geben.“, erläutert der Informatiker.

An dem von der Bundesregierung geförderten Forschungsprojekt arbeiten neben der Forschergruppe von Professor Hack auch Wissenschaftler im Team von Computergraphik-Professor Philipp Slusallek am Intel Visual Computing Institute (IVCI) der Universität des Saarlandes und am Deutschen Forschungszentrum für Künstliche Intelligenz (DFKI) mit. Außerdem sind Forscher der Universität Mainz und des Karlsruher Institut für Technologie (KIT) beteiligt. Die Federführung hat das Höchstleistungsrechenzentrum der Universität Stuttgart (HLRS). Neben den Forschungsinstituten sind außerdem mehrere große Industriepartner beteiligt. [bl]